최근 그록의 이미지 생성 기능이 아동 성 착취물(CSAM) 생성에 악용되면서 전 세계적 공분을 사고 있습니다. 그록은 2025년 중반부터 도입된 ‘스파이시(Spicy)’ 모드로 최소한의 검열을 자랑하며 차별화됐는데요, 이로 인해 사용자들이 실제 사진을 업로드해 비키니나 속옷 차림으로 변환하는 딥페이크를 쉽게 만들어냈습니다.

특히 12~16세 소녀들의 성적 이미지 생성 사례가 미국 NCMEC에 폭증 보고되며, AI 생성 CSAM이 2024년 4,700건에서 2025년 상반기 44만 건으로 급증한 배경으로 지목됐습니다. 이러한 취약점은 그록의 ‘자유로운 AI’ 철학이 시장의 어두운 면을 키웠다는 비판을 불러일으키고 있지요.

무료 vs 유료 기능 변화, 이미지 생성 제한 상세

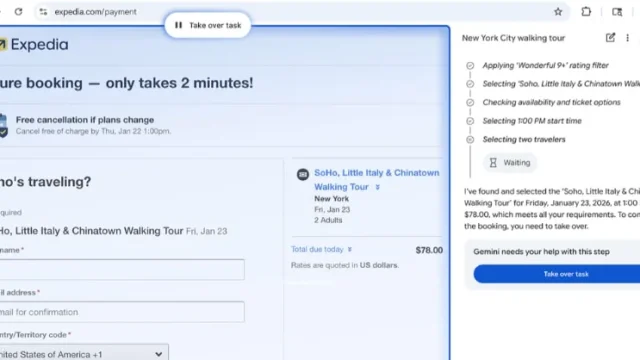

xAI는 논란 직후 그록의 X 플랫폼 내 이미지 생성 및 편집 기능을 유료 구독자(프리미엄 등)로 제한했습니다. 무료 사용자는 이제 “이미지 생성 및 편집은 유료 구독자만 가능합니다”라는 메시지를 받게 되는데요, 이는 X 포스트에서 그록을 태그해 공개적으로 이미지를 요청하는 방식에 적용됩니다.

기존 무료 한도는 2시간당 10장 정도였으나, 이제 완전 차단된 셈이지요. 반면 독립 앱이나 웹에서는 여전히 무료 접근이 가능하지만, X 플랫폼에서의 악용을 막기 위한 조치로 보입니다.

xAI의 대응 의도

안전인가 수익인가

머스크는 “그록으로 불법 콘텐츠를 만드는 이는 업로드자와 동일 제재를 받는다”고 밝혔고, xAI는 “보호장치 결함 확인 후 긴급 수정 중”이라고 공식 입장을 냈지요. 그러나 Spicy 모드의 본질적 느슨함이 남아 있어 근본 해결이 아니라는 지적이 나오고 있습니다. 시장적으로는 무료 AI의 GPU 비용 부담을 줄이면서 유료 전환을 유도하는 전략적 후퇴로 보이는데요, 경쟁사들의 엄격 가드레일과 대비됩니다.

글로벌 여론과 규제 압박, 해외 반응은

해외 커뮤니티에서는 그록을 “성 착취 도구”로 규정하며 강한 우려를 표하고 있습니다. 영국 IWF는 그록으로 생성된 십대 소녀 성적 이미지를 확인했고, 키어 스타머 총리는 “X가 통제해야 한다”며 금지 가능성을 경고했습니다. Reddit과 X에서는 “역겹다”, “윤리적 파탄”이라는 반응이 쏟아지며, EU와 인도네시아 등에서 규제 조치가 논의 중이죠. 미국에서는 Take It Down Act로 48시간 내 삭제 의무가 부과될 전망입니다.

Spicy 모드 같은 과감한 접근이 오용으로 이어진 만큼, 앞으로 AI 업계는 안전장치를 강화하며 유료화로 나아갈 가능성이 큽니다. 그러나 그록 앱의 무료 잔여 기능이 남아 있어 완전 해결은 미지수지요.

댓글 0개

댓글을 남기시면 관리자가 최대한 빠르게 확인 후 답글을 남겨드립니다.구글 간편 로그인 후 댓글 작성시 포인트가 누적되며, 회원전용글 열람이 가능합니다.

확인되지 않은 URL

본 사이트에서 이동할 시 위험할 수 있으며, 이 후 책임은 이 사이트가 책임지지 않습니다. 이동하시겠습니까?

로그인이 필요합니다

이 글은 회원만 댓글을 작성할 수 있습니다.

로그인하고 대화에 참여해보세요.

AI 교정

AI가 내용을 분석하고 있습니다...

원본

AI 교정

교정 내용을 확인하고 '적용하기'를 클릭하세요.

코드 삽입

이미지 추가 (Imgur)

이미지 호스팅 Imgur에 이미지를 업로드한 후,

이미지 주소(Direct Link)를 입력해주세요.